Le Son

Le cinéma, c’est le grand écran, l’image, mais pas que, le cinéma c’est aussi le son.< Dans cette partie nous ferons d’abord un bref historique de l’histoire du son dans le cinéma. Puis nous essaierons de répondre à des questions telles que : Quel type de microphone faut-il utiliser pour une situation particulière ? Quelles sont les différences techniques entre les microphones ? Comment restituer au mieux le son connaissant les capacités de l’oreille humaine ? Quels sont les différents types de son ( Mono, Stereo, … ) et leurs caractéristiques ?

Commençons d’abord par définir les termes et notions importantes que nous utiliserons dans cette partie.

Tout d’abord, un hémisphère constitue une moitié de sphère. L’amplification est le phénomène qui a pour but de produire des signaux audio suffisamment puissants pour alimenter un haut-parleur à partir de signaux audio de faible puissance (qui proviennent le plus souvent d’un instrument, ou d’un microphone).

Dans la même lignée, le pré-amplificateur a pour but quant à lui d’adapter le signal audio fournit par le microphone ou par l’instrument afin de le transmettre à l’amplificateur qui augmentera ensuite sa puissance.

La directivité correspond à la capacité d’un récepteur (exemple du microphone) ou d’un récepteur (exemple du haut-parleur) à remplir sa fonction suivant la ou les directions. Le décibel (de symbole dB) correspond en acoustique à l’unité de l’intensité acoustique. On la calcule grâce au rapport de la puissance par unité de surface du son mesuré par une puissance par unité de surface référence. L’utilisation de cette unité est un hommage à Alexandre Graham Bell inventeur du téléphone).

La cardioïde est une courbe plane. Sa forme est obtenue par la « trace » laissée par un point d’un cercle qui roule sur un autre cercle de même rayon.

Historique : Du Cinéma Parlant à nos jours

Le son, la parole et la musique ont toujours été parties intégrantes du cinéma.Au début du vingtième siècle les premiers films muets étaient commentés par le public lui même qui réagissait énormément aux premières projections.

Que ce soit avec le cinéma muet où une musique de fond est présente ou encore au début du siècle avec l’apparition du cinéma parlant, réussir à transmettre des émotions par le son est un vrai challenge pour les réalisateurs.

De nombreux systèmes ont permis de reproduire le son à l’écran, voici un panorama des créations qui ont marquées cette évolution.

Le chronophone et l’avènement du cinéma parlant: 1910-1927

En 1910, Léon Gaumont invente le chronophone, un système reliant le projecteur à un phonographe, les deux tournant à la même vitesse. Deux films marquent le démarrage de ce procédé : -«Lolotte» à l’exposition universelle de 1900 utilisant un procédé similaire de celui de Gaumont. -«Le chanteur de Jazz» de Warner Bros. en 1927 considéré comme le premier film parlant. Le principal problème de ce procédé est un synchronisme imparfait entre le son et l’image.

Création du son optique

Dès 1910 de nombreuses recherches par Eugène LAUSTE et Lee de FOREST entre autre mènent à la création du «son optique» ou «son photographique».

De nos jours, le son optique reste la norme en matière de son analogique et de son numérique. Puisqu'il s'agit d'une piste optique, l'enregistrement se fait par une caméra. La piste son est en noir et blanc sur le négatif juste à côté de la piste video.

Pour émettre le son,une lampe éclaire cette piste optique, l'intensité de la lumière traversant le film est mesurée par une cellule photoréceptrice qui transforme cette intensité en un signal électrique.Le signal électrique est ensuite amplifié pour être finalement reconverti en son par les enceintes du cinéma. Pour une meilleur précision le faisceau lumineux est focalisé sur la piste sonore grâce à une lentille convergente.

Cependant si on tient compte de la faible vitesse du son et de la taille des cinémas, le son arrivera plus tard au fond de la salle que sur le devant. C'est pourquoi le son est décalé légèrement de 21 images sur la copie afin d'obtenir un synchronisme correct sur l'ensemble de la salle.

Le son magnétique et le son multicanal

En 1931 Alan Blumlein met au point l'enregistrement de deux pistes optiques distinctes.

Arrive le son magnétique, de fines bandes d’oxyde métallique (semblables à la couche magnétique des bandes utilisées dans les magnétophones) couchées sur la copie du film.

La qualité offert par le son magnétique est bien meilleur au son optique et permet la création du son multicanal.

Les premiers sons stéréo sont composés de deux pistes magnétiques qui représentent les enceintes gauche et droite (figure 1) et qui seront à la base du Dolby Stereo. Elles sont implantées sur les bandes 35 mm et leurs intensités sonore sont divisées par deux pour garder la compatibilité avec les bandes mono.

Les pistes 70 mm se développent en parallèles (figure 2),la bande est composée de 4 pistes puis 6 pistes. A cause d’un cout trop fort et d’une durée de vie faible, les pistes magnétiques vont être abandonnées vers la fin des années 70 et les pistes 70 mm peu utilisées.

Le Dolby A et le Dolby Stéréo : 2 inventions majeurs

En 1967 Mr Ray Dolby présente le Dolby A. C'est un réducteur de bruit de fond qui permet d'améliorer la qualité du son sur les pistes optiques et la dynamique générale. Il sera d’ailleurs utilisé dans le film de Stanley Kubrick Orange mécanique en 1971.

Le Dolby Stéréo développé quelques années plus tard marque l’avènement d’une nouvelle ère dans le monde du cinéma. C’est Star Wars en 1977 qui utilise pour la première fois ce système.

Se servant des bandes 35mm,les deux pistes son transportent non seulement les informations stéréo gauche et droite mais aussi, grâce à un encodage, un troisième canal pour le centre et un quatrième canal arrière pour les sons d’ambiance et les effets spéciaux.

La technique utilisée est celle du matriçage dit 4/2/4. Très schématiquement, on récupère les 4 voies de la façon suivante :

-les signaux des canaux gauche et droite sont en phase (identiques) : ils sont envoyés sur la voie centrale.

-les signaux des canaux gauche et droite sont en opposition de phase (signal de gauche inverse de celui de droite) : ils sont remis en phase et envoyés sur la voie d'ambiance.

-les autres signaux sont conservés sur leurs voies respectives.

Le résultat permet d’obtenir un son multicanal équivalent au son 35mm 4 pistes magnétiques (qui devint rapidement obsolète). La fidélité est bien meilleure, la longévité plus grande et le tout pour un coût bien inférieur.

En 1986 Dolby améliore son système de réduction de bruit et lance le Dolby SR (pour Spectral Recording). De là, toutes les voies sonores sont en pleine bande. Les bandes-son des films deviennent spectaculaires.

D’autres améliorations seront faites et de nombreux supports créés :

Le Dolby surround pro-logic utilise à peu près le même système que le Dolby Stéréo mais y ajoute un filtre à 120Hz qui permet de passer les basses fréquences dans un canal dédié à une enceinte "sub-basses"

Le "Dolby surround pro-logic II" permet lui de désactiver le filtre à 120Hz ce qui est très utile pour écouter de la musique en surround. Il offre également pour la première fois deux canaux séparés pour le surround. La stéréo apparaît enfin dans le surround.

L’arrivée du numérique : 1990

Début 90, le son numérique est créé, beaucoup utilisé dans la compression de musique et qui engendra le type de codage AC-3.

Plusieurs procédés arrivent dans le milieu du cinéma dont Cinema Digital Sound de Kodak ou L.C Concept par des français.

Dolby lance le Dolby SRD (D pour digital) qui est une amélioration de son système Dolby SR en intégrant au bande 35 mm une piste numérique mais en gardant aussi les pistes Dolby Stereo pour les cinémas non équipés.

Ce format est crée en 1991 et apparaît pour la première fois dans le film Batman The Return. L'AC-3 est très souple il va du format mono au format 5.1 (gauche, centre, droite, surround gauche, surround droit et caisson de basse subwoofer : figure 5) qui sera utilisé par presque tous les compagnies de production, propose plusieurs fréquences d'échantillonnage (32K, 44.1K ou 48K Hz) et des taux de transfert variable (de 32 à 640 Kb/s). La plupart des productions codées en Dolby SRD sont en 384 Kb/s.

En 1995 pour le grand public le "SR-D" devient "Dolby digital" et apparaît dans les salons. Deux concurrents vont faire leurs entrées :

La société DTS (Digital Theater System) fondée par Terry Beard introduite dans l'industrie du cinéma en 1993 par Steven Spielberg et les studios Universal pour le film Jurassic Park Elle s’inspire du système L.C Concept en utilisant comme piste sonore la lecture d’un CD-ROM commandée par une piste de TimeCode sur la bande du film.

Sony se lance dans la compétition avec un système innovant nommé SDDS qui reprend les anciennes bandes magnétiques 70 mm et qui dispose de 7+1 canaux.

Aujourd'hui cohabitent dans les salles obscures soit les anciens procédés analogiques monophonique et Dolby Stéréo SR, ou les deux grands procédés numériques DTS, Dolby DIGITAL et dans une moindre mesure le SDDS.

La Restitution du Son : L’Ere du numérique

Qu’est-ce qu’un son numérique?Au lieu de manipuler directement le son analogique, il est possible de coder les variations du signal électro-acoustique sous forme numérique. Le signal obtenu est de type binaire. Il peut donc être utilisé par tout appareil électronique et informatique.

Conversion analogique - numérique

La conversion entre l’analogique et le numérique s’effectue grâce à deux opérations fondamentales : l’échantillonnage et la quantification.

L'échantillonnage consiste à prélever périodiquement des échantillons d'un signal analogique. Il est caractérisé par une fréquence d'échantillonnage qui influence la qualité du son ( de 44,1 KHz pour les CD et de 48 KHz pour les systèmes professionnels)

La quantification consiste à affecter une valeur numérique à chaque échantillon prélevé. En fonction de l'échelle de quantification retenue dépend la dynamique du système, plus cette échelle est grande plus elle sera précise. Un bit représente environ 6 dB de dynamique. Ainsi le CD avec des mots de 16 bits à une dynamique d'environ 96 dB et les systèmes professionnels actuels avec des mots de 24 bits auraient une dynamique de 144 dB (120 dB en pratique).

Le signal après être codé en 0 ou 1 est envoyé en créneau à tout matériel électronique et notamment aux graveurs qui vont incruster sur le cd le codage acquis. Pour la lecture, on utilise tout simplement le cycle inverse, du lecteur de cd qui lit le codage jusqu’aux enceintes qui reçoivent les signaux électriques correspondants.

La qualité du son dépend énormément du débit d’encodage allant de 120 à 320 kbit/s pour des musiques au format MP3 jusqu’à 4 millions de bites par seconde pour les CD !

Le Dolby Digital et les pistes sonores numériques

Le Dolby Digital créé en 1992 a été une invention importante pour le cinéma et est le précurseur du son numérique.

Il a beaucoup d’avantages :

-permet d’avoir un son numérique sans utiliser de cds séparés.

-la piste son qui contient les 6 canaux est directement insérée sur la bande 35 mm. -il garde les anciennes pistes analogiques permettant ainsi une compatibilité avec les anciens projecteurs.

Le Dolby Digital permet de disposer de cinq canaux large bande (gauche, centre, droit, surround gauche et surround droit), ainsi que d’un canal affecté aux effets basses fréquences (Low-Frequency Effects – LFE) destiné à la reproduction par un subwoofer.

Le son est encodé puis gravé sur la piste sous forme de points noir et blanc (voir figure)

Concernant le lecteur placé dans le projecteur il est composé de deux lumières qui éclairent chacune des bandes numériques et analogiques (fig 4)

Les Microphones

L’histoire du microphone est directement reliée à celle du téléphone. Le premier microphone a été inventé le 4mars 8177, mais c’est Graham Bell qui créé le premier microphone réellement utilisable en 1920.

Le principe d’un microphone est de capter les variations de pression de l’air que sont les ondes sonores et de les transformer en signal électrique appelé signal audio afin d’être retransmise par des haut-parleurs. On dit que le microphone est un transducteur électroacoustique ; il transforme l’énergie acoustique en énergie électrique. C’est donc un capteur analogique. L’avantage du signal électrique est qu’il peut être facilement traité.

Les ondes sonores excitent le diaphragme ou membrane qui est une partie mobile qui régit donc la transformation d’onde sonore en signal électrique. Par la suite un dispositif convertit en tension électrique les oscillations mécaniques produites par le diaphragme. Ce dispositif est variable selon le type de microphone ; il existe autant de dispositifs que de types microphone. Ensuite, la tension électrique ainsi produite est transportée vers l’amplification, la pré-amplification ou bien le système permettant l’enregistrement et auquel le micro est relié. Concernant « l’anatomie » externe du micro, une grille protège généralement la partie mobile du microphone pour éviter toute détérioration suite à un quelconque contact. On peut également observer des filtres permettant de « diminuer » les consonnes explosives, c'est-à-dire les sons « p », « b », etc…

Le microphone, le système d’amplification, de pré-amplification ou d’enregistrement qui lui sont associés se rapproche du mode de fonctionnement de l’oreille humaine (ou animale) dans la mesure où il possède un capteur (assimilable à l’oreille, le tympan), des voies de transport (assimilables au nerf auditif), et des dispositif de traitement et d’enregistrement (assimilables au cortex auditif et à la mémoire). Cependant il faut savoir qu’il n’existe aucun microphone capable d’exécuter toutes les tâches à la perfection, chaque microphone est fait pour une situation particulière de prise de son dans la mesure où chacun d’entre eux utilise une technologie différente, possède des caractéristiques électro-acoustiques différentes et une directivité différente, tandis que notre oreille elle est capable de s’adapter à différents milieux, différents environnements sonores afin d’être toujours efficace.

La directivité d’un microphone est le nom donné à la sensibilité du microphone en fonction de la provenance du son selon l’axe central du microphone. Le rendement optimal d’un microphone pour une tache de prise de son est directement relié à la directivité. En effet, tandis que certains microphones capteront tous les sons de leurs environnement sonores, d’autres capteront plutôt des sons particuliers. Les limites de la sensibilité d’un microphone dans l’espace s’appellent le diagramme polaire du microphone. Le diagramme polaire est constitué d’un cercle gradué au degré près avec une ordonnée exprimée en décibels ( db ) qui indique la sensibilité du microphone selon les fréquences. La directivité est optimale lorsque le diaphragme est orthogonal à la source sonore que l’on veut capter. On distingue quatre directivités principales : omnidirectionnelle, cardioïde large, cardioïde, hypercardioïde. Expliquons les nuances entres ces directivités.

D’abord, le microphone cardioïde. On dit d’un microphone qu’il est cardioïde lorsque sa sensibilité varie en fonction de la position de la source sonore par rapport à l’axe du micro en formant une courbe cardioïde. C’est le microphone unidirectionnel le plus répandu (il est par exemple utilisé pour le chant, la prise d’instrument …). Il perçoit les sons devant sa membrane et rejette ceux qui proviennent de l’arrière de sa membrane ; de plus il perçoit plus fortement les sons frontaux que les sons axiaux. Il créé un effet de proximité et on l’utilise pour éviter de capter les sons hors axe. Il est malgré tout assez polyvalent. C’est ce type de microphone qui est utilisé dans le microphone SOUNDFIELD qui regroupe quatre microphones cardioïdes et permet la prise de son multipiste.

Les microphones hypercardioïdes quant à eux sont semblables aux cardioïdes. Le lobe avant est un peu plus étroit et on retrouve une petite zone de captation à l’arrière. Ainsi, ils rejettent une plus grandes partie des sources latérales et arrières, et se focalisent sur les sons frontaux et proches, et permettent la prise de son de bruitages et d’autres effets sonores car ils permettent très facilement d’isoler une source sonore.

On peut également noter la présence des microphones supercardioïdes (on parle aussi de microphones canon), dont le lobe avant est encore plus étroit que sur les hypercardioïdes. Cette directivité permet de focaliser la prise de son sur un seul élément en l’isolant de l’environnement sonore restant. C’est souvent ce microphone que l’on perche au dessus de la tête des acteurs. Ces microphones permettent également la prise de son sur des sources lointaines, à la manière d’un « zoom acoustique » ; ils peuvent donc être utilisés pour la prise de son de documentaires animaliers.

Ensuite, les microphones omnidirectionnels perçoivent les sons dans une sphère sans privilégier de source sonore particulière, c'est-à-dire sur 360 degrés. Ils reçoivent toutes les sources sonores ainsi que leurs résonances, et sont privilégiés pour l’enregistrement d’ambiances. Ils captent cependant plus facilement les sons parasites à cause de leur large pouvoir de captation.

Enfin on peut noter l’existence des microphones bi-directionnels qui présentent deux zones de captation sphériques identiques à l’avant et à l’arrière permettant logiquement de capter très facilement et sans mouvement les sources sonores provenant de l’avant comme de l’arrière. Ce type de micros est particulièrement utilisé pour les interviews.

Finalement, il existe à l’heure actuelle des microphones capables de changer de directivité et ceux par une simple pression sur un bouton poussoir (c’est le cas par exemple du microphone AKG C414). D’autres microphones proposent des capsules interchangeables afin de changer de directivité.

On sait qu’il existe différents dispositifs permettant la conversation des oscillations mécaniques en tension électrique et par conséquent plusieurs types de microphones.

D’abord, le microphone à charbon à été inventé en 1878 par David Edward Hughes (physicien anglo-américain). Ce nom vient du fait que le microphone est constitué d’une membrane souple qui ferme une capsule contenant des grains de charbons maintenus entre deux électrodes (deux plaques métalliques). Dans ce dispositif, le charbon sert de résistance électrique. La variabilité de cette résistance repose sur la compression par la membrane souple (due à la vibration de l’onde sonore) des granules de charbon, ce qui entraîne un changement géométrique et donc module la résistance. On obtient en sortie un signal électrique variable. Le microphone à charbon a été notamment utilisé en téléphonie car il répond très bien à la fréquence de la voix humaine (de 200Hz environ jusqu’à environ 3000Hz). Il est aujourd’hui remplacé par le microphone électrostatique à électret qui a l’avantage d’être non seulement plus petit mais aussi plus fiable que le microphone à charbon.

Ensuite le microphone dynamique à bobine mobile comporte une bobine mobile aimantée qui est fixée à la membrane et à un aimant fixe. La membrane fait osciller la bobine mobile ce qui produit un courant, en effet la loi de Faraday stipule que le déplacement d’une bobine dans un champ magnétique produit une force électromotrice à ses bornes proportionnelle à son déplacement. Ce signal correspond au signal sonore. Les aimants au néodyme (métal du groupe des terres rares, de la famille des lanthanides) améliorent leur rendu, mais ce microphone ne gagne toujours pas la sympathie des professionnels du son (préférant souvent les microphones statiques) dans la mesure où il manque de sensibilité. Cependant il est très utilisé par les musiciens car il peut supporter de fortes pressions acoustiques (pour enregistrer la grosse caisse par exemple), et notamment sur scène où sa faible sensibilité devient un atout afin d’éviter l’effet de Larsen (effet obtenu lorsque l’émetteur amplifié et le récepteur sont placés trop près l’un de l’autre). Enfin ce type de microphone est très peu coûteux et assez résistant.

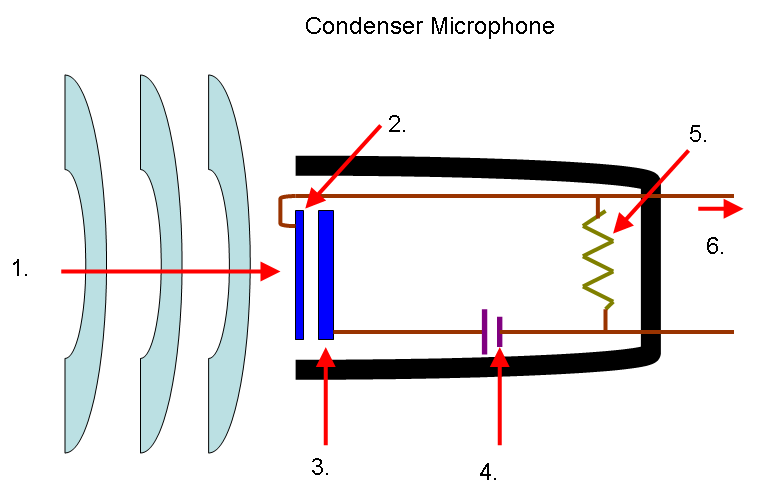

Le microphone électrostatique à condensateur utilise quant à lui l’électricité statique grâce à une membrane flottante que l’on sépare d’une plaque polarisée grâce à un isolant (l’air par exemple). Une fine couche d’un métal conducteur (souvent de l’or connu pour sa grande conductivité, raison pour laquelle, les meilleurs jack sont en plaqué or) permet de rendre conductrice la membrane coté intérieur. On forme ainsi un condensateur. Il est également possible de placer la membrane entre deux grilles métalliques et polarisées ( ce qui nécessite une tension électrique de l’ordre de 50V ). Les variations de pression acoustique engendrent le déplacement de la membrane qui permet la création d’un courant : le rapprochement par les vibrations vers l’une ou l’autre des membranes créé un courant grâce aux déplacements d’électrons. Le courant électrique obtenu doit ensuite passer dans une résistance pour donner la tension électrique finale. Ce microphone présente une excellente sensibilité. L’effet capacitif (électricité statique) produit donc une tension image de la pression acoustique. C’est un microphone très sensible permettant de capter des sons très éloignés (jusqu’à plusieurs kilomètres), et propose une reconstitution très fidèle. Cependant il est très fragile et sensible aux manipulations (en cela il ne peut servir de micro à main sauf s’il est muni d’une suspension interne), aux déplacements d’air, et il ne faut pas dépasser un certain seuil sonore sous peine que la membrane touche l’une des plaques, créant par conséquent un arc électrique ce qui endommage irrémédiablement la membrane. De plus leur signal de sortie est assez faible et il requiert donc l’utilisation d’un pré-amplificateur alimenté grâce à une alimentation extérieure appelée alimentation fantôme (ainsi nommée car la tension passe par le même canal que le signal sonore de sortie).

Le microphone électrostatique à électret possède un fonctionnement identique à celui du microphone à condensateur, si ce n’est qu’ici la membrane n’est pas entre deux plaques polarisées mais toujours au voisinage d’une seule qui a la particularité d’être polarisé en permanence ( certains matériaux possèdent en effet cette particularité lorsqu’ils ont subit certaines transformations [ exemple du polycarbonate métallisé qui lorsqu’il est polarisé avec un tension de kV à 120° puis refroidit brusquement conserve sa polarisation ] ), on parle d’électret ; ainsi ce microphone n’a pas besoin de tension de polarisation. Contrairement au microphone à condensateur ce type de microphone peut fournir sa propre alimentation grâce à une pile. Ce microphone a pour avantage de pouvoir être miniaturisé (certains sont de la taille d’une phalange), cependant il a tendance à perdre de sa sensibilité au fil du temps. Etant électrostatique, il possède donc les avantages et inconvénients du microphone à condensateur.

Le microphone à ruban, rendu populaire par le King Elvis Presley entre autre, mais développé dans les années 30, repose sur le principe d’une modification d’un champ électrique et donc du courant électrique. Un ruban d’alliage métallique (souvent on choisit l’aluminium pour sa légèreté) est inséré dans l’entrefer d’un puissant aimant ; lorsque celui-ci est alimenté il créé un champ électromagnétique qui génère donc un courant dans le ruban. Les variations de pression acoustique formées par l’onde sonore font se déplacer le ruban, qui ne se trouve plus dans l’axe du cylindre formé par l’aimant, ce qui résulte en une modification du champ électromagnétique et par conséquent une variation de l’intensité électrique. Cette variation est l’image des variations de pression acoustique. L’avantage de ce microphone est qu’il répond à une vaste gamme de fréquence et c’est également son inconvénient car il se comporte comme un récepteur audio à cause des nombreuses émissions radio.

Analysons maintenant les systèmes d’enregistrement du son stéréophonique. D’abord, les systèmes d’enregistrement stéréophoniques se divisent en deux catégories, ceux qui jouent sur les différences d’intensité, et ceux qui jouent sur les différences temporelles. Commençons par les différences temporelles. On distingue notamment trois systèmes. D’abord l’ORTF est un système composé de deux microphones cardioïdes, séparés par un angle de 110°. Les capsules sont elles éloignées de 17cm. L’angle d’enregistrement utile est de 90°.

Ensuite, le DIN est un système allemand dont les micros sont séparés par un angle de 90° et dont les capsules sont distantes de 20cm, ce qui donne une forte prédominance aux différences temporelles. L’angle d’enregistrement utile est de 100°. Enfin le NOS propose un angle de 90° séparant les microphones et une distance de 30cm entre les capsules. La différenciation temporelle est encore plus présente et l’angle d’enregistrement utile est de 80°.

Ensuite, étudions la stéréophonie d’intensité. D’abord le système XY. Il est composé de deux microphones cardioïdes avec un angle de 90° tandis que les capsules se situent au même endroit (on parle d’ailleurs de système coïncident). L’angle de prise de son utile est de 170° mais il reste modulable. Ce système joue énormément sur les différences d’intensité et non sur les différences temporelles. Ensuite, le système MS. Deux microphones sont placés l’un sur l’autre. L’un est bipolaire (c’est le microphone S) et l’autre est cardioïde (c’est le M). Le microphone cardioïde pointe vers l’avant tandis que le bidirectionnel pointe vers la gauche (lobe positif) et vers la droite. Il faut ensuite matricer pour pouvoir écouter les enregistrements. A gauche on fait (M+S)/2, tandis qu’à droite on fait (M-S)/2

Bibliographie

-http://www.epsic.ch/branches/electronique/techn99/acousthapp/THMIC.html-http://fr.wikipedia.org/wiki/Wikip%C3%A9dia:Accueil_principal

-http://www.er.uqam.ca/nobel/k24305/memoire.html#2

-http://pagesperso-orange.fr/pacson/SonCineA2.html

Livres : -Sonorisation et prise de son – 4e édition écrit par René Besson et Jean Alary aux éditons Dunod, collection audio-photo-vidéo.

-Théorie et pratique de la prise de son stéréophonique, écrit par Christian Hugonnet et Pierre Walder édition Eyrolles